|

|

| Taylor Swift là nạn nhân mới nhất của deepfake khiêu dâm. Ảnh:Matt Winkelmeyer. |

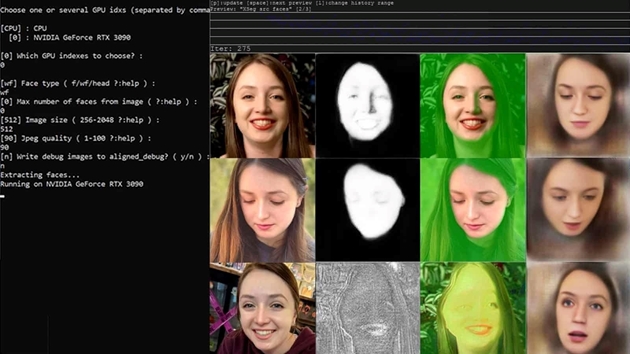

Ngày 26/1, hình ảnh deepfake của Taylor Swift lan truyền nhanh chóng trên X (trước đây là Twitter). Mạng xã hội này phản ứng chậm đến mức hình ảnh đã thu hút tới 47 triệu lượt xem trước khi bị gỡ xuống, theo The Guardian.

Hình ảnh khiêu dâm giả mạo khiến công chúng phẫn nộ, thậm chí Nhà Trắng còn gọi đó là "đáng báo động". Cuối cùng, X đã xóa những hình ảnh này và chặn các tìm kiếm đối với tên của ngôi sao nhạc pop vào tối 28/1.

Đối với những phụ nữ từng là nạn nhân của việc tạo và chia sẻ nội dung deepfake khiêu dâm không có sự đồng thuận, các sự kiện trong tuần qua là sự gợi nhớ khủng khiếp về tình trạng lạm dụng mà họ phải chịu đựng. Hầu hết vụ việc, kể cả liên quan đến những người nổi tiếng, đều không được chú ý đến mức buộc các nhà lập pháp phải hành động như trường hợp của Swift.

Nữ diễn viên 17 tuổi Xochitl Gomez gần đây đã bức xúc nói về việc X không xóa các nội dung deepfake về cô. "Chuyện này không liên quan gì đến tôi. Vậy mà nó vẫn ở trên đó với gương mặt của tôi", cô nói.

Trận chiến khó khăn

Noelle Martin là nạn nhân của nạn lạm dụng dựa trên hình ảnh, một thuật ngữ bao gồm việc chia sẻ những hình ảnh tình dục vô căn cứ và giả mạo rõ ràng. Cô lần đầu tiên phát hiện khuôn mặt của mình bị ghép vào nội dung khiêu dâm cách đây 11 năm.

"Những phụ nữ bình thường như tôi sẽ không có hàng triệu người nỗ lực bảo vệ và giúp gỡ bỏ nội dung đó. Chúng tôi cũng sẽ không nhận được sự giúp đỡ từ các công ty công nghệ lớn", cô nói.

Martin, nhà hoạt động và nhà nghiên cứu tại Phòng thí nghiệm Công nghệ & Chính sách tại Đại học Tây Úc, nói rằng ban đầu đó chỉ là những bức ảnh được chỉnh sửa, nhưng trong vài năm qua, khi AI bùng nổ, thì đó là những video, chủ yếu được chia sẻ trên các trang web khiêu dâm.

"Thật là kinh khủng! Tôi cố gắng không nhìn đến nó".

Martin nói rằng ngay cả khi những hình ảnh đó không thực sự đặc biệt, “nó vẫn đủ để gây ra tổn thất không thể khắc phục cho một người”. Nỗ lực loại bỏ những hình ảnh này khỏi Internet là một trận chiến khó khăn và mệt mỏi.

"Bạn không bao giờ có thể loại bỏ hoàn toàn. Nó ảnh hưởng đến mọi thứ, từ khả năng xin việc, kiếm tiền trong tương lai cho đến các mối quan hệ của bạn. Đó là một hình thức lạm dụng không thể tránh khỏi, gây ra hậu quả vĩnh viễn".

Martin đã phải đề cập đến vấn đề này trong các cuộc phỏng vấn xin việc và buổi hẹn hò. "Nó ảnh hưởng đến mọi khía cạnh trong cuộc sống của bạn".

|

|

| Laura Bates, tác giả cuốn sách Men Who Hate Women. Ảnh:Sophia Evans/The Observer. |

Khi nhà vận động và nhà văn Laura Bates xuất bản cuốn sách Men Who Hate Women, những người đàn ông gửi cho cô các hình ảnh khiêu dâm giả mạo. Cô nói rằng thật khó để mọi người hiểu được tác động của hình thức lạm dụng này, ngay cả khi bạn biết rõ hình ảnh đó không có thật.

"Có điều gì đó thực sự trực quan khi nhìn thấy một hình ảnh cực kỳ giống bạn trong tưởng tượng lệch lạc của một ai đó. Điều đó quá hèn hạ và nhục nhã. Nó cứ ám ảnh bạn và kinh khủng hơn khi hình ảnh đó có thể được chia sẻ cho hàng triệu người", cô nói.

Bates cho biết những hình ảnh và video khiêu dâm giả mạo "được lưu hành trong các cộng đồng cực đoan có quan điểm sai lầm về phụ nữ". Điều đặc biệt đáng chú ý trong vụ việc về Swift là deepfake nhạy cảm được phép lan truyền nhanh chóng trên các nền tảng truyền thông xã hội chính thống. Thời điểm những nơi này hành động thì chúng đã lan truyền trên hàng nghìn diễn đàn và trang web khác.

Một nghiên cứu năm 2019 của công ty an ninh mạng Deeptrace cho thấy 96% video deepfake trực tuyến là nội dung khiêu dâm. Khi phần lớn AI đang được sử dụng để tạo ra nội dung deepfake khiêu dâm, Bates nói "đó chỉ là cách mới để kiểm soát phụ nữ".

"Bạn làm vậy với Swift, người cực kỳ thành công và quyền lực. Đó là cách để nói với những phụ nữ khác: Không quan trọng bạn là ai, mạnh mẽ thế nào, chúng tôi vẫn có thể biến bạn thành đối tượng tình dục và bạn không thể làm gì với điều đó".

Hình ảnh giả nhưng hậu quả thật

Rani Govender, quan chức cấp cao về chính sách và quan hệ công tại NSPCC (Hiệp hội Quốc gia Phòng chống Bạo hành Trẻ em của Anh), cho biết: "Chúng tôi biết rằng đây là một vấn đề ảnh hưởng đến giới trẻ. Giống như các hình thức lạm dụng tình dục dựa trên hình ảnh khác, nó đặc biệt ảnh hưởng đến các bé gái".

Một cô gái 14 tuổi nói với dịch vụ ChildLine của NSPCC vào năm ngoái rằng một nhóm nam sinh đã tạo ra những hình ảnh khiêu dâm giả mạo của cô và các nữ sinh khác, rồi gửi chúng vào các cuộc trò chuyện nhóm. Nhóm này bị đuổi học một thời gian nhưng đã quay trở lại trường. Một cô gái khác, 15 tuổi, kể rằng một người lạ đã chụp ảnh từ tài khoản Instagram của cô và tạo những bức ảnh khỏa thân giả, sử dụng phòng ngủ thật của cô làm nền.

Govender cho biết loại nội dung này được những người lạ tạo ra trên mạng như một phần của quá trình "chăn chắt tình dục" hoặc có thể dùng để tống tiền và đe dọa trẻ em. AI cũng đã được sử dụng để tạo ra hình ảnh lạm dụng tình dục trẻ em, được những kẻ phạm tội chia sẻ và bán trên mạng.

|

|

| Vấn nạn tạo và lan truyền deepfake khiêu dâm ngày càng nghiêm trọng. Ảnh:Another Body. |

"Nếu việc sản xuất và chia sẻ nội dụng này trở nên dễ dàng hơn, điều đó cũng sẽ có tác động thực sự tiêu cực đến quan điểm của trẻ em về mức độ nghiêm trọng của những hình ảnh này", Govender nói.

Chiến dịch My Image My Choice được bắt đầu bởi những người tạo ra bộ phim Another Body năm 2023 , kể về một sinh viên kỹ thuật ở Mỹ đi tìm công lý sau khi phát hiện ra deepfake khiêu dâm của chính mình. Đồng đạo diễn của bộ phim, Sophie Compton, cho biết phần lớn phương tiện truyền thông đưa tin về AI "đang bỏ sót vấn đề bạo lực đối với phụ nữ".

Henry Ajder, chuyên gia về AI và deepfake, nói rằng so với những mối de dọa khác, deepfake khiêu dâm do AI tạo ra không cần phải quá giống thật thì vẫn có thể gây hại. "Nó rõ ràng là giả nhưng vẫn gây tổn thương và sỉ nhục".

Ajder lo ngại vấn đề sẽ trở nên nghiêm trọng hơn khi deepfake khiêu dâm ngày càng tinh vi, không chỉ chỉnh sửa hình ảnh mà còn có thể sao chép âm thanh. "Tôi lo lắng rằng không gian phát triển rất nhanh của video tổng hợp do AI tạo ra kết hợp với thực tế ảo sẽ dẫn đến nhiều hành vi lạm dụng hơn, đặc biệt đối với phụ nữ".

Bates cho rằng xã hội cần phải loại bỏ quan điểm rằng vì deepfake khiêu dâm là trực tuyến hoặc bị dán nhãn là giả nên nó không có hại. "Mọi người nghĩ đây không phải là bạo lực, lạm dụng tình dục. Không có bất kỳ trách nhiệm nào đối với các công ty công nghệ đang cho phép những thứ này phổ biến; không có bất kỳ hình thức trừng phạt nào khi cho phép điều này xảy ra cả".

Tuy nhiên, cho dù bạn là nữ sinh, phụ nữ hay ngôi sao nhạc pop toàn cầu, một khi những hình ảnh đó xuất hiện, Bates chỉ ra rằng mọi thứ đã là quá muộn.

Theo lifestyle.zingnews